Anotace:

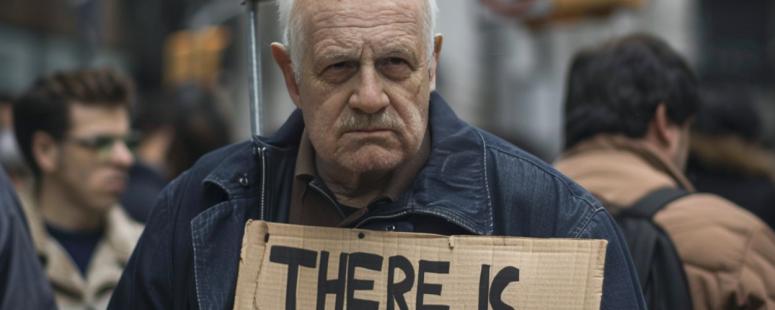

Často zaznívá, že máme žáky připravovat na život v 21. století. Cítím v tom jisté opovržení dobou minulou. Přitom se můžeme učit o zítřku právě z ní. Zeptala jsem se ChatuGPT, jak by mi Descartovu metodickou skepsi vysvětlil na fenoménu DEEP FAKE. A ejhle:

Descartův přístup k poznání zdůrazňoval pochybování o všem, co není absolutně jisté, aby se dosáhlo pravdivého poznání. Aplikace Descartovy metodické skepse na fenomén deepfake by zahrnovala několik kroků:

1. Pochybování o autenticitě: V prvním kroku by Descartes možná pochyboval o autentičnosti jakéhokoli obrazového nebo audio materiálu, dokud by nebyly přítomny nesporné důkazy o jeho pravosti. To znamená, že by bylo zpochybněno vše, co by mohlo být uměle vytvořeno nebo modifikováno technologií deepfake.

2. Hledání nesporných důkazů: Descartes by hledal metody, jak odhalit DEEP FAKE. Mohlo by se jednat o analýzu jemných nedokonalostí v audiovizuálním materiálu nebo o využití technologií založených na umělé inteligenci, které dokážou rozpoznat nepřirozené vzorce v pohybech obličeje, v očích nebo v hlase.

3. Závěrečná verifikace: Jakmile by byly shromážděny důkazy, Descartes by pravděpodobně usiloval o jejich konečnou verifikaci skrze logickou analýzu a empirické ověření, aby bylo možné dosáhnout jasného a rozumného závěru o pravdivosti nebo falši daného materiálu.

4. Etické a filozofické implikace: Descartes by také zvažoval etické a filozofické důsledky existence a používání deepfake technologií. Zamýšlel by se nad tím, jak tyto technologie ovlivňují naše chápání pravdy a reality a jaké mají dopady na důvěru a autenticitu v digitálním věku.

Descartova metodika by tedy mohla poskytnout framework pro kritické myšlení o DEEP FAKE. a jeho dopadech na společnost, politiku a osobní identitu. Základní princip pochybování o všem, dokud není prokázáno opak, je v době DEEP FAKE technologií zvlášť relevantní, jelikož tyto technologie mohou zpochybnit naše tradiční chápání pravdivosti a reality.

No, v podstatě se v lekci nedozvíte nic jiného, ale je vytvořena tak, aby si na vše přišli žáci sami. Lekce vychází z projektu Josefa Šlerky: Testování hranic AI: Nevěřte tomu, co vidíte

Samostudium:

V rámci projektu Testování hranic AI zveřejnil datový analytik a redaktor Investigace.cz Josef Šlerka falešné video Václava Klause zhotovené v řádu minut na volně dostupných nástrojích generativní umělé inteligence. O jeho přesvědčivosti a o nepřipravenosti řady diváků svědčí vlna reakcí, které do redakce přišly. Jaké výzvy nám přináší dnešní technologické možnosti i doba, ve které potřeba autenticity ustupuje míře diváckého zaujetí? V Odposlechu se ptal Petr Gojda.

https://www.investigace.cz/podcast-odposlech-s-josefem-slerkou-o-deepfake/

“Projekt je podpořený grantem Velvyslanectví USA v Praze.”

| Příloha | Velikost |

|---|---|

| 688.96 KB | |

| 1.96 MB | |

| 554.14 KB |

- Pro psaní komentářů se přihlaste nebo zaregistrujte.